Comparaison des dépendances des processeurs GeForce et Radeon dans DX12

Bonne journée! Sans trop de préambule, disons tout de suite ce qui nous a poussé à faire ce comparatif vidéo de la populaire chaîne youtube australienne. Matériel non emballé, qui a comparé la dépendance au processeur des cartes vidéo Radeon et GeForce dans les API de bas niveau (DX12, Vulkan), et ont obtenu des résultats inattendus pour la plupart.

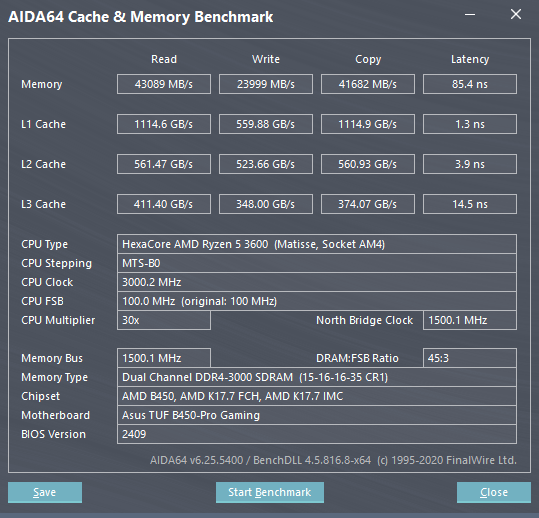

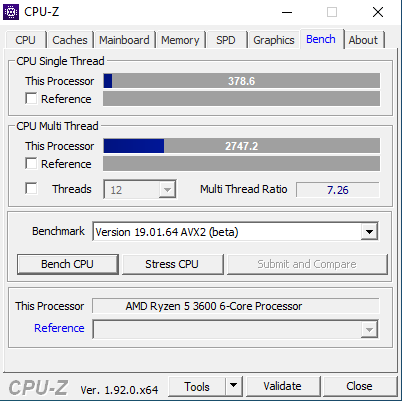

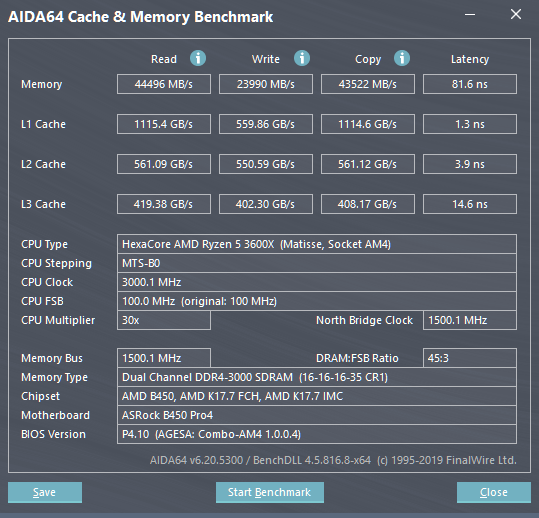

Bien sûr, la politique de notre publication est exclusivement vraie sous toutes ses formes et manifestations, et nous avons décidé de vérifier à dessein à quel point cela est vrai, sans approximer les résultats, pour comparer les cartes vidéo en tête-à-tête Radeon et GeForce en conjonction avec les mêmes processeurs - Ryzen 5 3600. Mais du fait que nous avons une RAM différente, il a un potentiel d'overclocking complètement différent, et en plus, nous avons des cartes vidéo, pour le moins, de différents niveaux - RTX 3090 et Radeon RX Vega 64 Liquid Cooling (ci-après - LC), nous avons décidé d'opter pour quelques astuces - réduire la fréquence du processeur à 3 GHz et réinitialiser la RAM à 3000 MHz et les timings du profil XMP afin d'empêcher la "divulgation de la carte vidéo" RX Vega 64 LC de prendre place. En conséquence, nous avons obtenu des processeurs presque 100% identiques, avec une différence dans le niveau d'erreur.

Alors, bancs d'essai :

1.

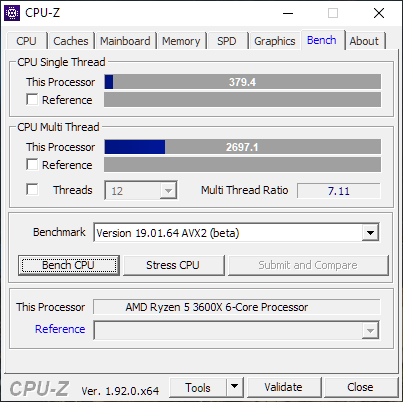

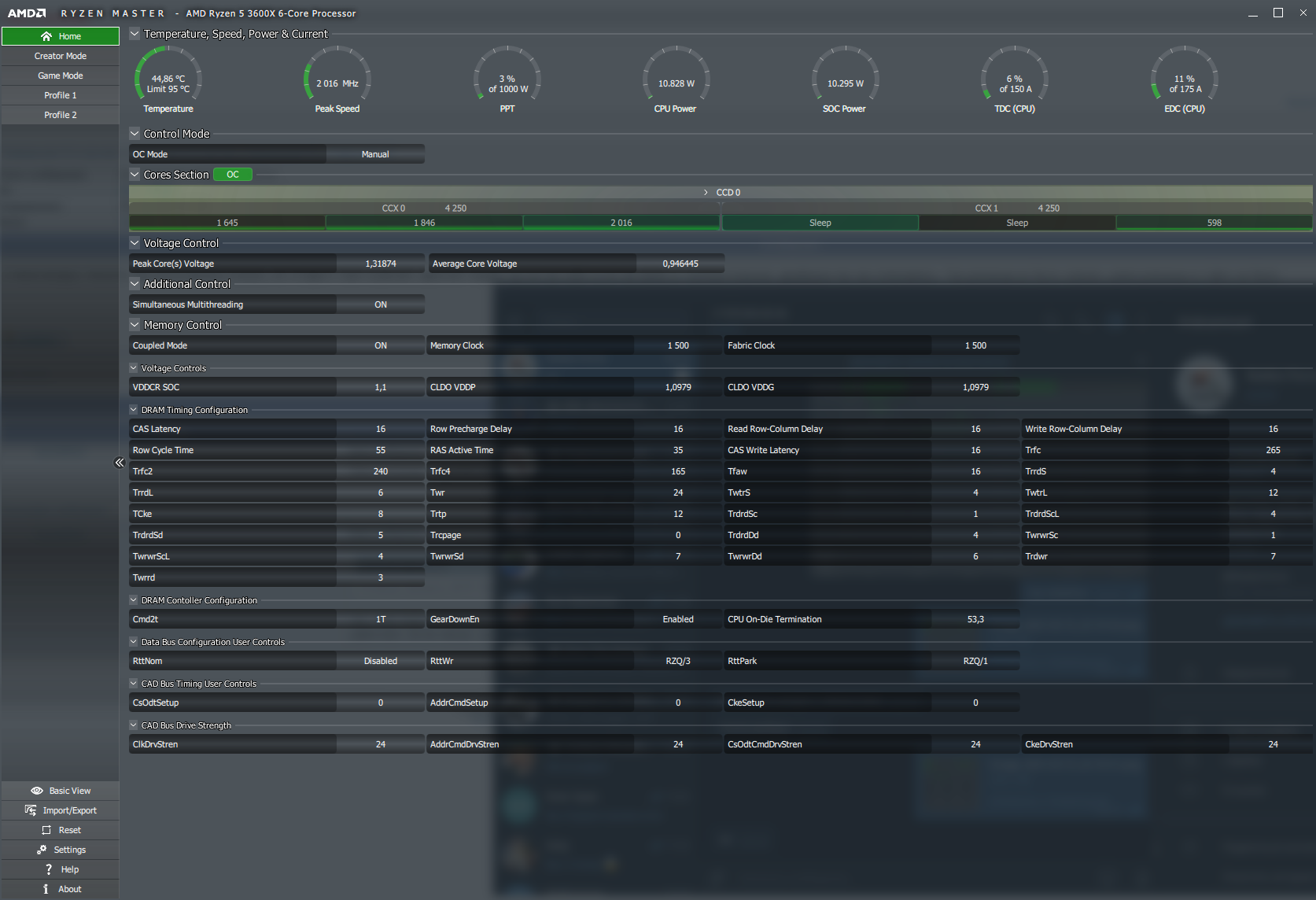

Processeur : AMD Ryzen 5 3600X (Matisse, L3 32 Mo), 6 cœurs/12 threads, fixe 3000 MHz

Carte graphique : Palit Gaming pro RTX 3090 1830/22000

Carte mère : Asrock B450 Pro4, AM4

RAM : Crucial Ballistix Tactical 2x8 Go 3000 CL16

Sous-système de disque : nvme A-Data XPG SX8200 Pro, 2 To

2.

Processeur : AMD Ryzen 5 3600 (Matisse, L3 32 Mo), 6 cœurs/12 threads, fixe 3000 MHz

Carte graphique : AMD Radeon RX Vega 64 Liquid Cooling ~1700/1108(+timings)

Carte mère : ASUS TUF B450-pro Gaming, AM4

RAM : Crucial Ballistix Sport LT 2x8 Go 3000 CL15

Sous-système de disque : nvme Samsung 970 EVO Plus 512 Go

En conséquence, dans notre cas "tronqué", cela ressemblera à ceci :

Ce R5 3600 sera couplé avec le RX Vega 64 LC

Et celui-ci est en conjonction avec le RTX 3090

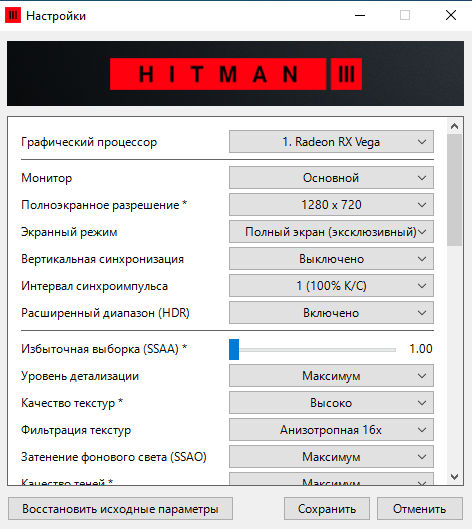

En conséquence, même sur un R5 3600 aussi "réduit", il était impossible de ne pas tomber sur le RX Vega 64 LC à la résolution minimale aux paramètres graphiques maximaux, et il a donc été décidé de le tester aux paramètres minimaux . Et dans ce cas, cette option nous convient tout à fait, car le but n'est pas de mesurer les performances absolues du processeur, mais de vérifier combien de performances plus ou moins un processeur donné avec des cartes vidéo d'une famille chinoise concurrente peut fournir. Aux réglages maximum, nous n'avons réussi qu'à conduire un homme chauve... euh, pour tester Hitman 3, et puis seulement à un endroit, sur un châssis statique qui charge le plus le processeur.

1. Hitman 3 - Mission "Mendoza, Argentine"

Paramètres:

Congeler directement :

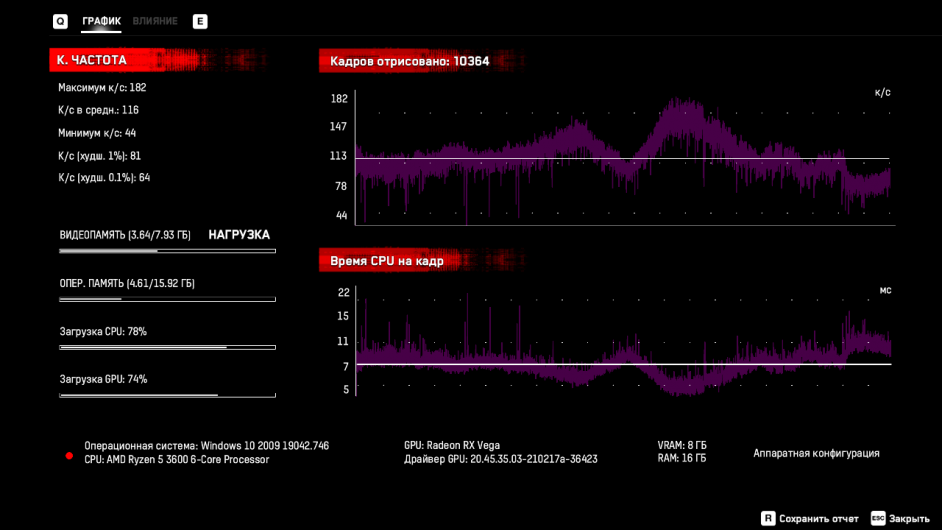

RX Véga 64LC

RTX 3090

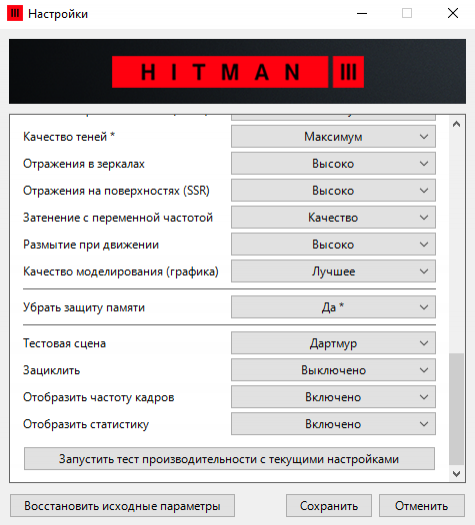

Et aussitôt nous sommes frappés par une différence assez tangible dans % 22.4.

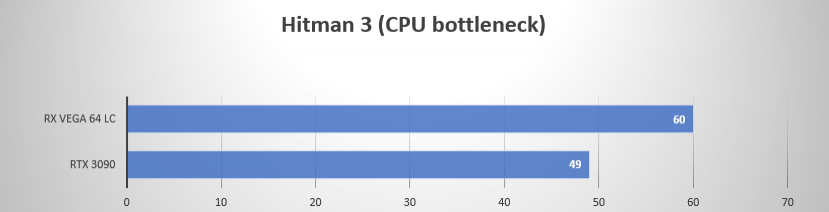

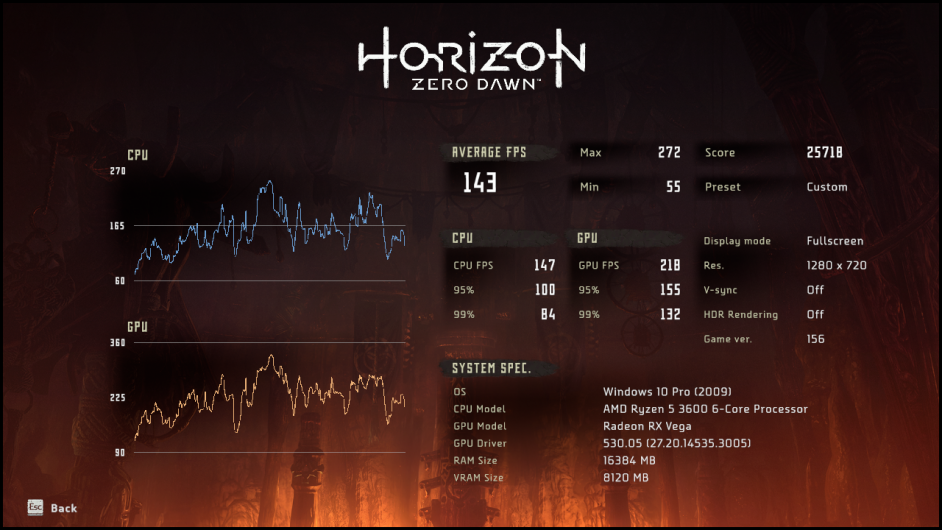

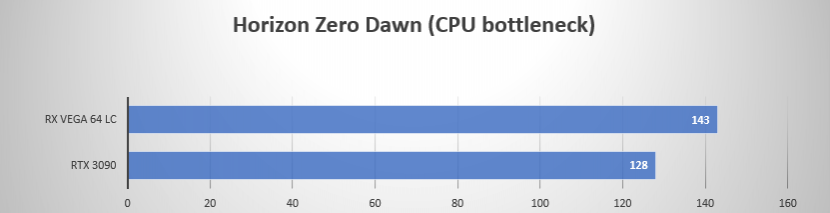

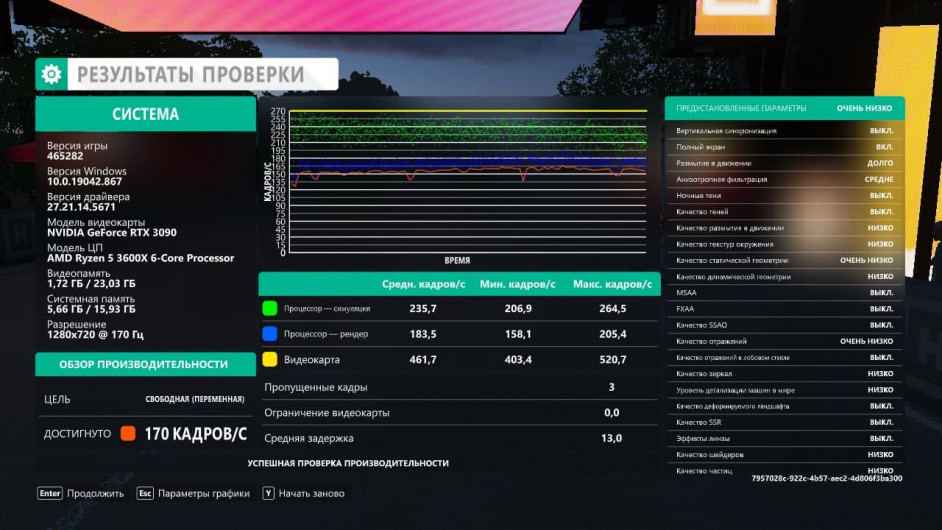

2. Horizon Zero Dawn

Paramètres : minimum, 720p, échelle de résolution minimale

RX Véga 64LC

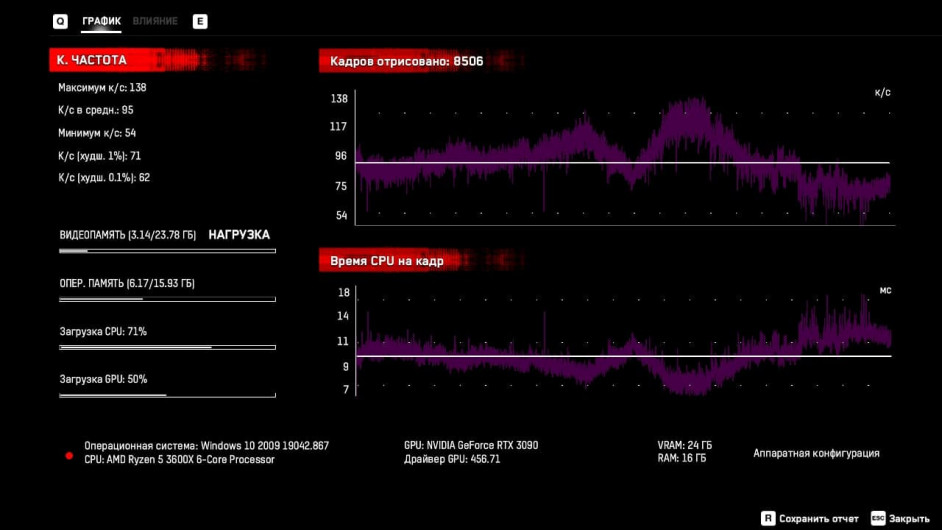

RTX 3090

Ici on voit la différence 11.7%.

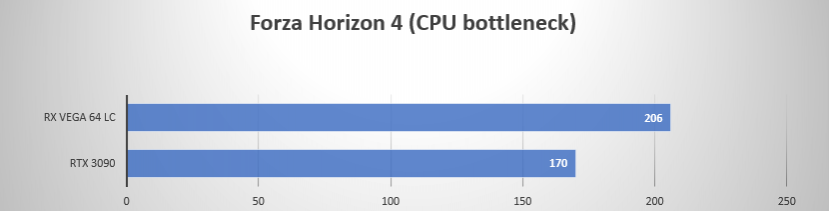

3. Forza Horizon 4 Demo

Paramètres : salaire minimum complet, 720p

RX Véga 64LC

RTX 3090

Ici, la différence était 21.1%

Eh bien, voyons maintenant quelques jeux "sous le patronage" de Nvidia, la situation va-t-elle changer en eux ?

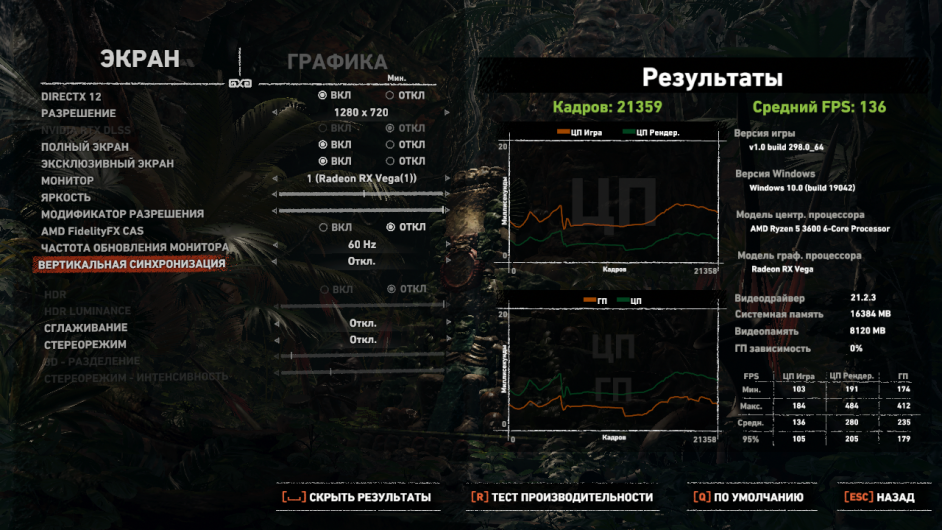

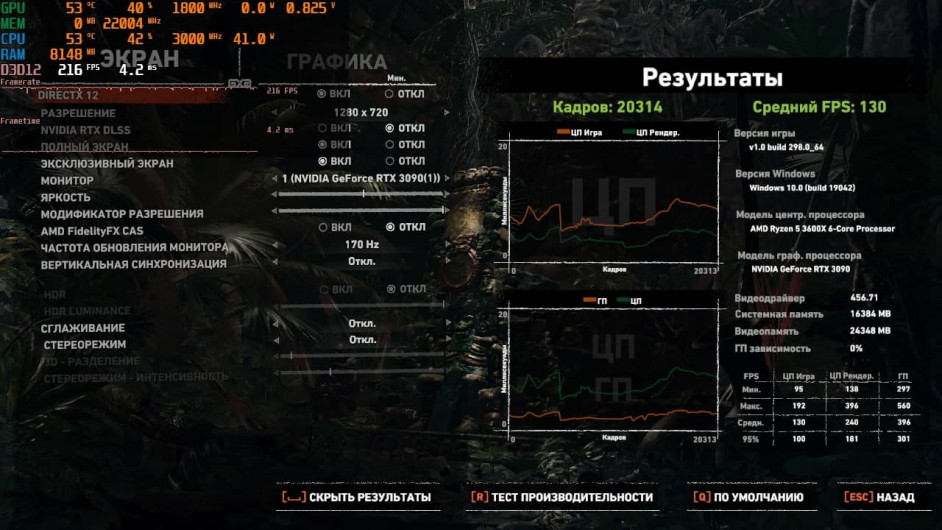

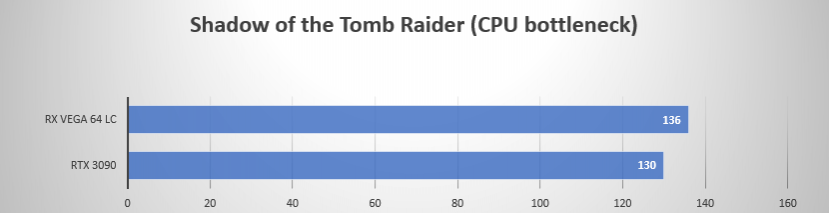

4. L'Ombre du Tomb Raider

Paramètres : minimum, 720p, échelle de résolution minimale

RX Véga 64LC

RTX 3090

Et on voit immédiatement une amélioration notable. La différence était modeste % 4.6, qui, à notre avis, se situe dans la fourchette normale

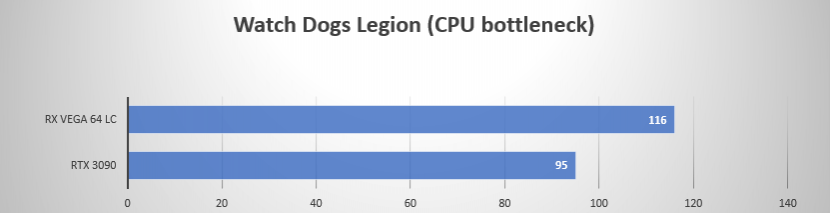

5. Légion des chiens de garde

Paramètres : minimum, 720p, échelle de résolution minimum, FOV 110

RTX 3090

Bien, que puis-je dire. La différence n'est rien de moins 22.1%.

Nous ne nous attendions certainement pas à cela : parmi les 5 jeux testés, la plus grande différence a été enregistrée dans le jeu avec le logo "Nvidia" (bien sûr, avec Hitman 3, qui avait la même différence). Il semblait également étrange que dans le seul jeu de notre test avec le logo AMD - Horizon Zero Dawn, la différence se soit avérée assez "démocratique" par rapport à ce que nous avons vu dans la Watch Dogs Legion "verte"...

En général, essayons de commenter tout cela d'une manière ou d'une autre: bien sûr, nous ne prétendrons pas que nous ne connaissions pas cette situation depuis 6 ans (depuis l'apparition des premiers jeux sur DX12), mais il nous a toujours semblé étrange que personne n'a jamais été affecté - pas un seul blogueur, pas une seule publication (sauf, bien sûr, GameGPU, mais des chiffres secs sont donnés ici, et tout le monde ne "tord" pas les diagrammes et ne remarque pas cette tendance). Mais à un moment donné, seuls les paresseux n'ont pas discuté de la forte dépendance au processeur de Radeon dans DX11, où cela s'est réellement produit, et a été confirmé par des tests plus d'une fois. Mais pourquoi a-t-il été activement discuté à l'époque, et comme s'il était délibérément gardé silencieux maintenant ? À notre avis, c'est une approche fondamentalement erronée, car s'il y a un certain problème, il doit être résolu, et la vieille Jen Sun sait comment résoudre les problèmes comme personne d'autre.

Il est temps de se rendre compte que l'ère des API de bas niveau est arrivée, les mises en page sont retournées sur le devant de la scène, mais jusqu'à présent, de nombreuses publications et blogueurs inattentifs continuent de recommander GeForce pour les processeurs faibles, et continuent d'évoquer la forte dépendance processeur de Radeon , soit par ignorance, soit pour une autre raison qui m'est inconnue.

Je ne dirais pas que c'est un problème fatal, comme c'était le cas avec les Radeon dans DX11, si vous avez un processeur plus ou moins productif. Mais si vous avez un assemblage déséquilibré avec un processeur faible (FX, ancien Xeon, 4 threads, etc.) et que vous envisagez d'acheter une carte vidéo puissante, vous devriez au moins clarifier quelle API est dans les jeux pour laquelle la carte vidéo est achetée. Si le jeu est exigeant sur le processeur et dans celui-ci DX11 - alors avec 99% de probabilité, il vaut mieux prendre GeForce, même s'il est inférieur à la Radeon concurrente en termes de performances pures avec le meilleur processeur - de toute façon, vous vous concentrerez principalement sur le processeur, et dans de telles situations dans dx11 nvidia vous donnera généralement plus de fps. Si DX12 (jusqu'à Vulkan nous y reviendrons dans la prochaine revue) - en conséquence, Radeon sera le meilleur choix pour un processeur faible. Et notre examen en est la meilleure confirmation, car l'API utilisée dans le jeu pour certains assemblages peut tout chambouler, et même une carte vidéo haut de gamme n'aidera pas contre l'ancienne moyenne.

CONCLUSION:

Essayons de résumer tout cela et d'énoncer l'essence de l'article et des tests : le même processeur dans DX12 est capable de fournir le FPS le plus élevé avec les cartes vidéo AMD Radeon, la différence peut facilement dépasser 20 %. Et cela devrait être pris en compte, tout d'abord, par les propriétaires de moniteurs avec des matrices à haute fréquence ou les propriétaires de processeurs faibles et médiocres. Si vous avez entendu un autre blogueur dire que les Radeon sont plus dépendantes du processeur que les Geforces, alors au mieux il n'est pas au courant (comment est-ce possible si ça dure depuis 6 ans !), au pire, il est soit incompétent soit une partie intéressée.

Je le répète : les Radeon dépendent davantage du processeur dans DX11. Dans DX12, la situation est inversée. La situation dans le Volcano et d'autres API (déjà obsolètes, mais à des fins éducatives générales) sera analysée plus tard.

J'espère que cette critique a aidé quelqu'un et que tout cela n'a pas été vain. Merci pour votre attention et votre compréhension !